Wir sollten theoretische Modelle als Begründung für Eingriffe in Grundrechte verbieten.

Edgar L. Gärtner

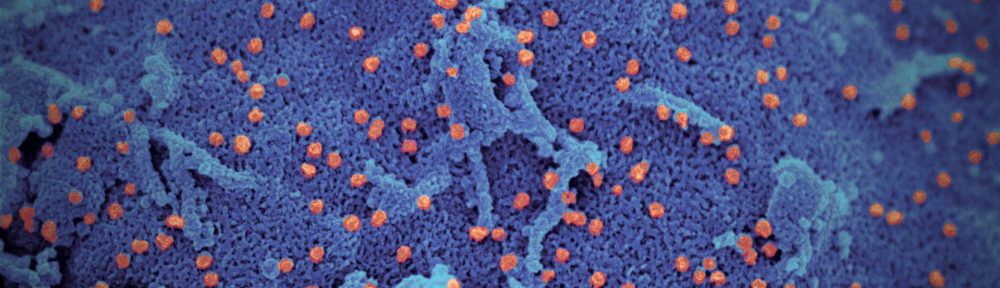

Exosomen (links), behauptetes SARS-CoV-2 (rechts). Quelle: Rubikon

Schon in der 2007 erschienenen ersten Auflage meines Buches „Öko-Nihilismus“ habe ich davor gewarnt, man werde wohl bald nicht mehr zwischen Computersimulationen mathematischer Modelle und der realen Welt unterscheiden können. Inzwischen ist die Konfusion Realität. Seit der im Auftrag des Club of Rome erstellten Computersimulations-Studie „Die Grenzen des Wachstums“ (1972) werden staatliche Eingriffe in Grundrechte wie das Recht auf Privateigentum sowie Meinungs- und Bewegungsfreiheit immer öfter mit dem Verweis auf theoretische Modelle eines angeblich exponentiellen Wachstums von Problemen wie Umweltbelastung, Ressourcenerschöpfung und neuerdings Virusinfektionen gerechtfertigt. Dabei tritt unbegrenztes exponentielles Wachstum sowohl in der Natur als auch in der Gesellschaft nur sehr selten auf. Bei einer Epidemie nur im theoretischen Fall, dass in der Bevölkerung keinerlei Abwehrkräfte vorhanden sind. In der Regel kommt es nur als aufsteigender Ast einer sigmoidalen Sättigungskurve vor. Das hat Angela Merkel nicht davon abgehalten, ein angeblich exponentielles Wachstum der SARS-CoV-2-Infektionen als Begründung für den von ihr unter Umgehung des Bundestages durchgedrückten Oster-Lockdown zu benutzen. Immerhin wurde sie schon am Folgetag, dem 24. März 2021, gezwungen, den drastischsten Teil ihres Beschlusses zumindest dem Anschein nach wieder zurück zu nehmen. In Wirklichkeit hält sie daran fest, im Einsperren der Menschen die einzig wirksame Maßnahme gegen die Verbreitung von Viren zu sehen.

Dabei zeigt der Vergleich zwischen Deutschland und dem US-Ferienparadies Florida, wo es seit dem letzten Sommer keinerlei Corona-bedingte Beschränkungen des täglichen Lebens gibt, dass Lockdowns keinerlei positiven Einfluss auf die Infektionskurven und die Anzahl der Todesopfer haben – negativen dagegen schon. Weiterlesen

Bei Sozialisten und Grünen war es schon immer schwer, zwischen Selbsttäuschung und bewusster Lüge zu unterscheiden. So ist es auch bei dem schon lange vor der Kernreaktor-Havarie von Tschernobyl im Jahre 1986 von jungen Wissenschaftlern im Umkreis des Freiburger Öko-Instituts geprägten Begriff „Energiewende“. Bereits im Jahre 1980 legten Autoren des Instituts eine Studie mit dem verheißungsvollen Titel „Energiewende – Wachstum und Wohlstand ohne Erdöl und Uran“ vor. Kohlekraftwerke schienen damals noch kein Problem zu sein. Es ging um die Verminderung unserer Abhängigkeit vom Öl des Nahen Ostens und von der damals von linken Grünen schon verteufelten Kernenergie. Im Jahre 1985 veröffentlichten Peter Hennicke, Jeffrey P. Johnson, Stephan Kohler und Dieter Seifried im Frankfurter S. Fischer Verlag eine dicke Studie mit dem Titel „Die Energiewende ist möglich. Für eine neue Energiepolitik der Kommunen“. Wie der Titel andeutet, ging es darin um die Brechung der Macht der großen Stromkonzerne durch die Rekommunalisierung und Dezentralisierung der Elektrizitätsversorgung. Mit der Reaktorkatastrophe von Fukushima hat die Forderung einer radikalen „Energiewende“, historisch betrachtet, nichts zu tun. Dafür schon eher mit dem Wiedererstarken romantischer Strömungen nach der Studentenrevolte von 1968.

Bei Sozialisten und Grünen war es schon immer schwer, zwischen Selbsttäuschung und bewusster Lüge zu unterscheiden. So ist es auch bei dem schon lange vor der Kernreaktor-Havarie von Tschernobyl im Jahre 1986 von jungen Wissenschaftlern im Umkreis des Freiburger Öko-Instituts geprägten Begriff „Energiewende“. Bereits im Jahre 1980 legten Autoren des Instituts eine Studie mit dem verheißungsvollen Titel „Energiewende – Wachstum und Wohlstand ohne Erdöl und Uran“ vor. Kohlekraftwerke schienen damals noch kein Problem zu sein. Es ging um die Verminderung unserer Abhängigkeit vom Öl des Nahen Ostens und von der damals von linken Grünen schon verteufelten Kernenergie. Im Jahre 1985 veröffentlichten Peter Hennicke, Jeffrey P. Johnson, Stephan Kohler und Dieter Seifried im Frankfurter S. Fischer Verlag eine dicke Studie mit dem Titel „Die Energiewende ist möglich. Für eine neue Energiepolitik der Kommunen“. Wie der Titel andeutet, ging es darin um die Brechung der Macht der großen Stromkonzerne durch die Rekommunalisierung und Dezentralisierung der Elektrizitätsversorgung. Mit der Reaktorkatastrophe von Fukushima hat die Forderung einer radikalen „Energiewende“, historisch betrachtet, nichts zu tun. Dafür schon eher mit dem Wiedererstarken romantischer Strömungen nach der Studentenrevolte von 1968.